زامبيها و آدمهاي فضايي تهديدي واقعي براي گونهي ما نيستند. در واقع فقط يكي از كاراكترهاي شرور فيلمهاي سينمايي است كه حضورش در دنياي واقعي ما را نگران ميكند: ربات آگاه. مشخص نيست چه زماني پاي آنها به زندگي ما بازخواهد شد. اما بياييد لحظهاي به آنها فكر كنيم. دنيا با وجود آنها به چه شكل خواهد بود؟ بگذاريد سؤالي اساسيتر مطرح كنم. جاي ما در چنين جهاني كجا خواهد بود؟ آيا اساسا جايي براي ما باقي خواهد ماند؟

اخيرا پژوهشهاي هوش مصنوعي انقلابي جديد را پشت سر گذاردهاند. در حال حاضر سيستمهاي مبتني بر هوش مصنوعي در بازيهايي مانند شطرنج و گو، بهتر از انسانها عمل ميكنند، ميتوانند چهرهها را تشخيص دهند و رانندگي امني انجام دهند. بااينحال، بيشتر پژوهشگران ميگويند كه ماشينهاي آگاه، ماشينهايي كه فقط برنامههاي نوشتهشده را اجرا نميكنند؛ بلكه احساس دارند و خودآگاه هستند، دههها با واقعيت يافتن فاصله دارند. آنها كه چنين عقيدهاي دارند، اينگونه استدلال ميكنند كه پژوهشگران بايد هوشي عمومي، ماشيني با همهي تواناييهاي ذكرشده در بالا و قابليت يادگيري بسازند. در اينجا خواهد بود كه هوش مصنوعي به سطحي از پيچيدگي كه براي آگاهي نياز است، خواهد رسيد.

واضح است كه افرادي مخالف اين استدلال هستند. جاستين هارت، دانشمند رايانه در دانشگاه تگزاس، ميگويد:

مردم بر اين باورند كه خودآگاهي نقطهي پايان پژوهشهاي هوش مصنوعي است و زماني رخ خواهد داد كه ديگر هيچ پروژهي علمي ديگري باقي نمانده باشد.

او و ديگر پژوهشگران در حال ساخت ماشينهايي با ذهنهاي اوليه هستند. يكي از رباتهاي آنها مانند بچهاي تازه متولدشده، تقلا ميكند تا بدنش را درك كند. يكي ديگر از رباتها در مورد چيزهايي كه ميبيند، لغات نامفهوم به زبان ميآورد و اگر او را بزنيد گريه ميكند. يكي ديگر از اين رباتها بهگونهاي تنظيم شده است كه جهاني مختص خودش را كشف كند.

هيچ كس ادعا نميكند كه رباتها تجربهي دروني غني دارند. آنها از طبقاتي كه جارو كردهاند احساس غرور نميكنند يا جريان ۱۲۰ ولت به آنها احساس لذت نميدهد. اما اكنون رباتها ميتوانند برخي كيفيتهاي مشابه مغز انسان، مانند همدلي، انطباقپذيري و تفكر را از خود نشان دهند.

پژوهشگران اين مخلوقات سايبري را از اين جهت طراحي ميكنند كه نقصهاي سيستمهاي مبتني بر يادگيري ماشين را تصحيح كنند. اين سيستمها قدرتمند اما مبهم هستند. مبناي كار آنها، ارتباط دادن ورودي به خروجي است؛ درست مانند آزمونهايي كه در آن گزينههاي موجود در ستون آ را به گزينههاي مناسب آنها در ستون ب متصل ميكنيد. اساسا سيستمهاي هوش مصنوعي اين ارتباطها را در حافظهي خود ذخيره ميكنند. هيچ منطق عميقتري در پس پاسخهاي آنها وجود ندارد و مشكل دقيقا همينجا است.

از سوي ديگر، خواندن ذهن انسانها و پيشبيني آنها دشوار است. ما زمان قابل توجهي را صرف تحليل خودمان و ديگران ميكنيم؛ امري كه نقش اصلي ذهن خودآگاه ما محسوب ميشود. اگر ماشينها ذهن داشته باشند، نفوذناپذير نخواهند بود. ما ميتوانيم بهسادگي از آنها دليل انجام كارهايشان را بپرسيم.

سلمر برينگجرد، پژوهشگر هوش مصنوعي در انستيتوي پليتكنيك رنسلير در تروي-نيويورك، ميگويد:

اگر ميتوانستيم به بخشي از ساختار خودآگاهي دست پيدا كنيم، ظرفيتهاي بسيار خوبي توليد ميشد.

داستانهاي علمي تخيلي ما را از رباتهايي كه ميتوانند حس كنند، ترساندهاند. اما شايد اين رباتهاي بدون ذهن هستند كه بايد از آنها هراسان باشيم؛ شايد رباتهاي خودآگاه متحدان ما باشند.

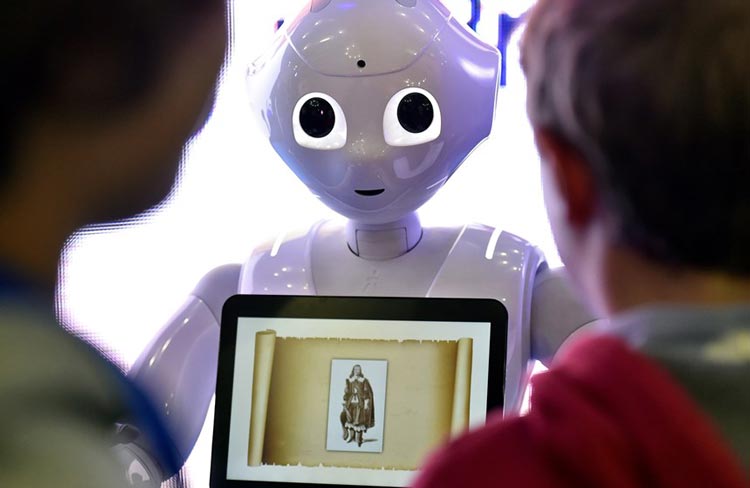

نمايشگاه جهاني رباتيك، مادريد ۲۰۱۶. كودكان در حال برقراري ارتباط با پپر (ربات انساننما) هستند كه توسط آلداباران رباتيك (شركت رباتيك فرانسوي) توسعه داده شده است.

رباتها در جستجوي خودشناسي

امروزه، خودروهاي خودران به پيشرفتهترين سيستمهاي هوش مصنوعي مجهز هستند. آنها با توجه به ديتاي رادار و ليزر و وارد كردن آنها در الگوريتمها، تصميم ميگيرند چه هنگام ترمز كنند و چه هنگام جهت حركت خود را عوض كنند. اما رانندگي بيشتر به تشخيص حركات ديگر رانندهها و واكنش دفاعي به آنها مربوط است؛ عملكردهايي كه به آگاهي ربط دارند.

پل ورشور، عصبشناس دانشگاه بارسلونا، ميگويد:

خودروهاي خودران بايد ذهن ديگر خودروهاي خودران را بخوانند تا بفهمند آنها چه ميخواهند كنند.

هاد ليپسون، استاد دانشگاه كلمبيا و يونگ جونگ كيم، در دانشگاه سجونگ سئول، رباتي ساختهاند كه يك رانندهي بيملاحظه است. اين ربات دايرهاي كوچك، در مسيري دايرهاي با منطق خودش حركت ميكند. ربات دوم بهگونهاي تنظيم ميشود كه بتواند مسير حركت ربات اول را بدون توجه به نقطهي شروع آن رهگيري كند؛ بنابراين ربات دوم نميتواند يك مسير ثابت را ثبت كند. ربات دوم بايد منطق حركتي ربات اول را بفهمد. ليپسون و كيم با استفاده از روندي مشابه تكامل دارويني، يك استراتژي رهگيري ايجاد كردند. ليپسون ميگويد:

اين استراتژي بدلي از يك ذهن كنشگر بود. گرچه كامل نيست؛ اما آنقدر خوب هست كه بتواند حركتهاي بعدي ربات اول را پيشبيني كند.

تيم ليپسون يك ربات ديگر هم ساخته است كه ميتواند به دركي از بدن خود برسد. اين ماشين عنكبوتي چهارپا ابعاد يك تارانتولا را دارد. وقتي اين ربات روشن ميشود، كامپيوتر دروني او هيچ اطلاعاتي در مورد بدنش ندارد. ليپسون ميگويد:

اين ماشين نميداند كه موتورهايش چه ترتيبي دارند يا بدنش به چه شكل است.

اما اين ربات ميتواند ياد بگيرد. اين ربات هر قسمت از بدنهاش را كه بتواند حركت ميدهد تا ببيند چه اتفاقي ميافتد. براي مثال، ياد ميگيرد كه چگونه روشن كردن يك موتور، مفصل يك پا را خم ميكند. ليپسون ميگويد اين ربات موتورهايش را بهصورت تصادفي روشن ميكند.

چهار روز خستهكننده ميگذرد و سرانجام ربات ميفهمد كه چهار پا دارد و سپس كشف ميكند كه چگونه آنها را مكانيابي كند و حركت دهد تا از يك طرف اتاق به سمت ديگر برود. ليپسون يكي از موتورها را جدا ميكند. ربات متوجه ميشود كه اكنون فقط سه پا دارد و كنشهاي او منجر به نتيجهي مورد انتظارش نميشود. ليپسون ميگويد:

به نحوي اين ربات در مراحل بسيار ابتدايي خودآگاهي قرار دارد.

ديگر قابليت انسانمانندي كه پژوهشگران مايل هستند در هوش مصنوعي قرار دهند، ابتكار است. ماشينها در بازي گو استاد هستند؛ زيرا انسانها آنها را براي حل معماها هدايت كردهاند. تعريف كردن صورت مسئله، سختترين قسمت حل آن است و رباتها از انجام اين كار ناتوان هستند.

ريوتا كاناي، عصبشناس و بنيانگذار استارتآپ آرايا در توكيو، در مقالهاي در ژورنال Trends in Cognitive Science، ايجاد انگيزههاي ذاتي در رباتها را بررسي كرده است. او و همكارانش، رانندههايي را شبيهسازي كردند كه در محيطي مجازي رانندگي ميكنند. خودروي آنها به تپهاي با شيب زياد ميرسد كه بالا رفتن از آن تنها در صورتي ممكن است كه خودرو هل داده شود. تا زماني كه به رانندهها فرمان داده نشود كه راهي براي بالا رفتن از تپه پيدا كنند، آنها ساكن در جاي خود باقي ميمانند.

تيم كاناي اين رانندهها را با عامل كنجكاوي برنامهريزي ميكنند. آنها محيط را بررسي كردند، تپه را بهعنوان يك مشكل تشخيص دادند و فهميدند كه حتي بدون دريافت دستورالعمل، چگونه از آن بالا بروند. كاناي ميگويد:

ما به رانندهها هدف نداديم. آنها محيط اطراف خود را بررسي ميكنند و با پيشبيني نتايج كنش خودشان، موقعيت را ارزيابي ميكنند.

در واقع به رباتها بهاندازهاي انگيزه ذاتي داده شد كه مسائل را بهتر حل كنند؛ نه آنقدر كه تصميم بگيرند از آزمايش خارج شوند. ماشينها ميتوانند بهاندازهي انسانها لجوج باشند. جاشوا باخ، پژوهشگر هوش مصنوعي هاروارد، رباتهاي مجازي را در محيطي مجازي پر از قارچهاي خوشمزه اما سمي قرار داد. او انتظار داشت آنها ياد بگيرند كه از آن قارچها دوري كنند؛ اما رباتها مدام در حال خوردن آن قارچهاي سمي بودند. باخ ميگويد:

همانطور كه انسانها تجربههايشان را دست كم ميگيرند، رباتها هم همينگونه بودند؛ آنها اصلا توجه نميكردند. قارچها خيلي خوشمزه بودند و رباتها فقط به همين توجه ميكردند.

باخ مجبور شد حس نفرت از قارچها را به رباتها القا كند. به عبارت ديگر، رباتها بايد ارزشها را ياد بگيرند و نهفقط هدفها را.

توجه كردن

علاوه بر خودآگاهي و خودانگيزشي، ديگر عملكرد كليدي آگاهي، توانايي تمركز است. اخيرا «توجه انتخابي» به زمينهاي مهم در پژوهشهاي هوش مصنوعي تبديل شده است. گوگل ديپمايند كه كامپيوتر بازيكن گو را توسعه داده است، تنها شركتي نيست كه به اين مهم ميپردازد.

استنلي فرانكلين، استاد علوم كامپيوتر در دانشگاه ممفيس، ميگويد:

آگاهي از فيلترهاي توجه است.

فرانكلين و همكارانش سال گذشته مقالهاي در Biology Inspired Cognitive Architectures منتشر كردند. آنها در اين مقاله، پروسه ساخت سيستم هوش مصنوعياي به نام ليدا را بررسي كردند. ليدا ميتواند تصميم بگيرد كه در طول يك پروسهي رقابت بر چه چيزهايي تمركز كند. عصبشناسي به نام برنارد بارز در دههي ۸۰ ميلادي، چنين پروسه ساختي را پيشنهاد كرده بود. اين فرايند محركهاي جالبي مانند بلندي صدا، روشنايي يا موارد خارجي را شناسايي ميكند و سپس براي برنده شدن مبارزه ميكند. وقتي اين فرايند غالب ميشود، مشخص ميكند چه زماني قدرت ذهني ضعف دارد و طيف وسيعي از عملكردهاي مغز، شامل مشورت و حركت را آگاه ميكند. چرخهي ادراك، توجه و اقدام پنج تا ده بار در ثانيه تكرار ميشود.

نخستين نسخهي ليدا، يك سرور شغلياب براي نيروي دريايي آمريكا بود. او ايميلها را ميخواند، بر اطلاعات مربوطه تمركز ميكرد و درعينحال علاقهمنديهاي هر جوياي كار، فراهم بودن فرصت شغلي و الزامات بوروكراسي دولتي را هم در نظر ميگرفت.

از آن زمان تاكنون، تيم فرانكلين از اين سيستم براي مدلسازي ذهن حيوانات، بهويژه تغييرات رفتاري ناشي از تمركز فقط بر يك چيز، استفاده كرده است. بهعنوان مثال، ليدا درست مانند انسانها پديدهاي روانشناختي به اسم «غفلت عمدي» را نشان ميدهد. وقتي چيزي توجه شما را جلب ميكند، شما براي نيمي از ثانيه، نسبت به هر چيز ديگري بيتوجه ميشويد. اين نقطه كور شناختي، به عوامل متعددي بستگي دارد و ليدا به همان عوامل، واكنشي انساني نشان ميدهد.

پنتي هايكونن، پژوهشگر فنلاندي هوش مصنوعي، با اصول مشابه رباتي به نام XCR-1 ساخته است.هايكونن، برخلاف ديگر پژوهشگران كه در مورد ساختههاي خود ادعاهاي سادهاي مانند دستيابي به درجاتي از آگاهي دارند، ادعا ميكند كه ساختهي او تجربه واقعي ذهني و احساسات اصلي را دارد.

سيستم ياد ميگيرد ارتباطاتي مانند نورونها در مغز ما ايجاد كند. اگر هايكونن به ربات يك توپ «سبز» نشان دهد و كلمهي «سبز» را بگويد، ماژول شنوايي و بينايي پاسخ ميدهند و ارتباط برقرار ميكنند. اگر هايكونن فقط كلمهي «سبز» را بگويد، ماژول شنوايي پاسخ خواهد داد و بر اساس ارتباطي كه قبلا ايجاد شد، ماژول بينايي هم پاسخ خواهد داد. ربات تا زماني كه كلمه را بشنود يا رنگ را ببيند، به اين روند ادامه خواهد داد، حتي اگر به دوري باطل بيانجامد.

عكس اين حالت هم صادق است؛ اگر ربات رنگ «سبز» را ببيند، حتي اگر نام «سبز» گفته نشود، ماژول شنوايي پاسخ خواهد داد. اگر بخواهم خلاصهتر بگويم، در واقع ربات گونهاي سينستزيا در خود توسعه داده است. سينستزيا به اين معني است كه وقتي يكي از حواس شما فعال ميشود، يك حس نامربوط ديگر همزمان و متأثر از آن فعال ميشود.

هايكونن ميگويد:

اگر ما يك توپ را ببينيم، ممكن است ديدن توپ را به خود بگوييم. در آن زمان ادراك ما بهگونهاي است كه انگار واقعا آن كلمه را شنيدهايم. اين اتفاقي است كه براي XCR-1 ميافتد.

حال در نظر بگيريد كه ماژولها با نوعي تناقض روبرو شوند. شرايط جالبي پيش خواهد آمد. براي مثال، ماژول بينايي رنگ «سبز» را ميبيند؛ اما آنچه ماژول شنوايي ميشنود، كلمه «آبي» است. اگر ماژول شنوايي غالب باشد، سيستم بهعنوان يك كليت، تمام توجه خود را به آنچه ميشنود، متمركز ميكند و رنگي را كه ميبيند، ناديده ميانگارد. ربات جرياني بسيار ساده از خودآگاهي دارد كه از ادراكي ايجاد شده است كه لحظهبهلحظه بر آن مستولي ميشود: سبز، توپ، آبي و ... وقتي هايكونن ماژول شنوايي را به يك موتور گفتاري متصل ميكند، ربات در مورد هرچه ميبيند و احساس ميكند، مونولوگي بدون توقف ايراد ميكند.

هايكونن ارتعاش را بهعنوان درد براي ربات تعريف ميكند. اين حس، تمامي وروديهاي حسي ديگر را متوقف كرده و تمام توجه ربات را به خود جلب ميكند. يك بار هايكونن به ربات ضربه زد؛ ربات گفت: «من صدمه ديد.»

هايكونن ميگويد:

برخي از مردم به دلايلي با ديدن چنين موردي، احساس ناراحتي ميكنند.

او و برخي ديگر از پژوهشگران به آفريدههاي خود حسي ندارند. مثلا ورشور بيان ميگويد: «من هرگز چنين آدمي نيستم كه رباتي را ببينم و بگويم آخي! ربات بيچاره!»

گونهاي جديد

پژوهشگران بر اساس تلاشهاي اوليهي خود، رباتهايي شبيهتر به موجودات زنده ميسازند. در طبيعت سيستمهاي هوشيار بيشماري از جانداران تكسلولي و سگ گرفته تا شامپانزه و انسان وجود دارد. پيشرفت تدريجي اين فناوري خوب است؛ زيرا به ما زمان ميدهد تا به اين ايده كه روزي، ديگر تنها موجودات پيشرفته روي كرهي زمين نخواهيم بود، خو بگيريم.

براي مدتزماني طولاني، همراهان مصنوعي ما آسيبپذير خواهند بود. در واقع آنها بيشتر شبيه حيوانات دستآموز ما هستند تا اينكه تهديدي براي ما باشند. نحوهي رفتار ما با آنها به اين امر وابسته خواهد بود كه آيا آنها را موجوداتي آگاه ميدانيم كه ميتوانند رنج بكشند يا خير.

سوزان اشنايدر، فيلسوفي در دانشگاه كانتيكت است كه پيامدهاي هوش مصنوعي را بررسي ميكند. او ميگويد:

ما به حيوانات خيلي بها ميدهيم، گاهي به همان اندازه كه به انسانها بها ميدهيم؛ زيرا بر اساس آگاهي خود ميدانيم كه حيوانات هم آگاهي دارند.

در واقع او معتقد است كه ما عمدا از ساخت ماشينهاي آگاه خودداري ميكنيم تا از معضلات اخلاقي كه پيش ميآورد، جلوگيري كنيم.

اشنايدر ميگويد:

اگر ما ماشينهايي آگاه بسازيم و سپس آنها را مجبور كنيم براي ما كار كنند؛ اين كار چيزي جز بردهداري نيست. به همين ترتيب، اگر به رباتهاي پيشرفته، ادراك ندهيم، تهديد احتمالي آنها براي بشريت بدتر خواهد شد؛ چرا كه آنها هيچ دليل خاصي نمييابند تا ما را شناسايي كنند و براي ما ارزش قائل شوند.

اين ماشينها، قابليت حل مسئلهي ما را به بسيار گسترش خواهند داد؛ اما هر چيزي يك مسئلهي حل كردني نيست. تنها واكنشي كه رباتها ميتوانند به تجربهي آگاهانه داشته باشند، لذت بردن از آن است. آنها با محدوده گستردهتري از ادراك حسي، چيزهايي را خواهند ديد كه مردم باور نميكنند. ليپسون ميگويد:

من فكر نميكنم گونههاي رباتي آينده، بيروح و سرد باشند؛ آنها احتمالا موسيقي و شعر خواهند داشت كه ما هرگز درك نخواهيم كرد.

دانلود آهنگ جديد مهدي احمدوند به نام خلسه

دانلود آهنگ جديد مهدي احمدوند به نام خلسه دانلود آلبوم اوردوز ۳

دانلود آلبوم اوردوز ۳ دانلود آهنگ جديد بهنام باني به نام تويي انتخابم

دانلود آهنگ جديد بهنام باني به نام تويي انتخابم دانلود آهنگ جديد سينا شعبانخاني به نام هيس

دانلود آهنگ جديد سينا شعبانخاني به نام هيس